简介

在 logistic 回归中,我们的训练集由m个已标记的样本构成:

,其中输入特徵

。(我们对符号的约定如下:特徵向量x的维度为n+1,其中

对应截距项 。) 由于 logistic 回归是针对二分类问题的,因此类标记

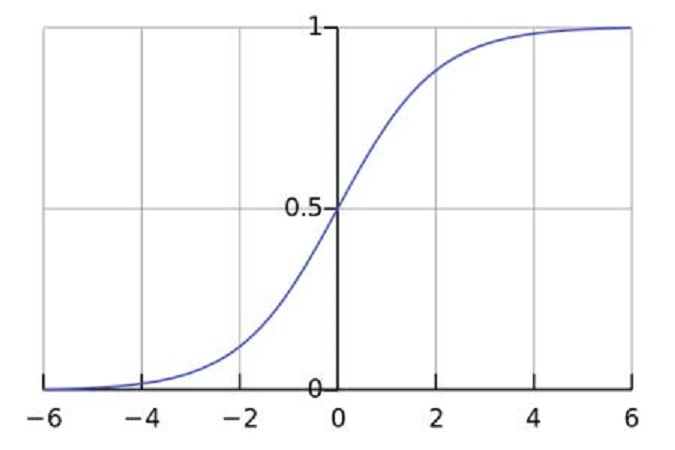

。假设函式(hypothesis function) 如下:

在 softmax回归中,我们解决的是多分类问题(相对于 logistic 回归解决的二分类问题),类标

可以取

个不同的值(而不是 2 个)。因此,对于训练集

,我们有

。(注意此处的类别下标从 1 开始,而不是 0)。例如,在 MNIST 数字识别任务中,我们有

个不同的类别。

对于给定的测试输入

,我们想用假设函式针对每一个类别j估算出机率值

。也就是说,我们想估计

的每一种分类结果出现的机率。因此,我们的假设函式将要输出一个

维的向量(向量元素的和为1)来表示这

个估计的机率值。 具体地说,我们的假设函式

形式如下:

其中

是模型的参数。请注意

这一项对机率分布进行归一化,使得所有机率之和为 1 。

为了方便起见,我们同样使用符号

来表示全部的模型参数。在实现Softmax回归时,将

用一个

的矩阵来表示会很方便,该矩阵是将

按行罗列起来得到的,如下所示:

代价函式

我们来介绍 softmax 回归算法的代价函式。在下面的公式中,1是示性函式,其取值规则为:

1{值为真的表达式}=1

1{值为假的表达式} =0。举例来说,表达式

的值为1 ,

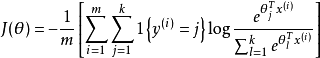

的值为 0。我们的代价函式为:

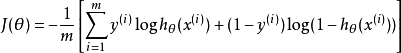

值得注意的是,上述公式是logistic回归代价函式的推广。logistic回归代价函式可以改为:

可以看到,Softmax代价函式与logistic 代价函式在形式上非常类似,只是在Softmax损失函式中对类标记的

个可能值进行了累加。注意在Softmax回归中将

分类为类别

的机率为:

对于

的最小化问题,当前还没有闭式解法。因此,我们使用叠代的最佳化算法(例如梯度下降法,或 L-BFGS)。经过求导,我们得到梯度公式如下:

让我们来回顾一下符号 "

" 的含义。

本身是一个向量,它的第

个元素

是

对

的第

个分量的偏导数。

有了上面的偏导数公式以后,我们就可以将它代入到梯度下降法等算法中,来最小化

。 例如,在梯度下降法的标準实现中,每一次叠代需要进行如下更新:

(

)。

当实现 softmax 回归算法时, 我们通常会使用上述代价函式的一个改进版本。具体来说,就是和权重衰减(weight decay)一起使用。我们接下来介绍使用它的动机和细节。

Softmax回归模型参数化的特点

Softmax 回归有一个不寻常的特点:它有一个“冗余”的参数集。为了便于阐述这一特点,假设我们从参数向量

中减去了向量

,这时,每一个

都变成了

(

)。此时假设函式变成了以下的式子:

换句话说,从

中减去

完全不影响假设函式的预测结果!这表明前面的 softmax 回归模型中存在冗余的参数。更正式一点来说, Softmax 模型被过度参数化了。对于任意一个用于拟合数据的假设函式,可以求出多组参数值,这些参数得到的是完全相同的假设函式

。

进一步而言,如果参数

是代价函式

的极小值点,那幺

同样也是它的极小值点,其中

可以为任意向量。因此使

最小化的解不是独立的。(有趣的是,由于

仍然是一个凸函式,因此梯度下降时不会遇到局部最优解的问题。但是 Hessian 矩阵是奇异的不可逆的,这会直接导致採用牛顿法最佳化就遇到数值计算的问题)

注意,当

时,我们总是可以将

替换为

(即替换为全零向量),并且这种变换不会影响假设函式。因此我们可以去掉参数向量

(或者其他

中的任意一个)而不影响假设函式的表达能力。实际上,与其最佳化全部的

个参数

(其中

),我们可以令

,只最佳化剩余的

个参数,这样算法依然能够正常工作。

在实际套用中,为了使算法实现更简单清楚,往往保留所有参数

,而不任意地将某一参数设定为 0。但此时我们需要对代价函式做一个改动:加入权重衰减。权重衰减可以解决 softmax 回归的参数冗余所带来的数值问题。

权重衰减

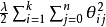

我们通过添加一个权重衰减项

来修改代价函式,这个衰减项会惩罚过大的参数值,我们的代价函式变为:

有了这个权重衰减项以后 (

),代价函式就变成了严格的凸函式,这样就可以保证得到独立的解了。 此时的 Hessian矩阵变为可逆矩阵,并且因为

是凸函式,梯度下降法和 L-BFGS 等算法可以保证收敛到全局最优解。

为了使用最佳化算法,我们需要求得这个新函式

的导数,如下:

通过最小化

,我们就能实现一个可用的 softmax 回归模型。

Softmax回归与Logistic 回归的关係

当类别数

时,softmax 回归退化为 logistic 回归。这表明 softmax 回归是 logistic 回归的一般形式。具体地说,当

时,softmax 回归的假设函式为:

利用softmax回归参数冗余的特点,我们令

,并且从两个参数向量中都减去向量

,得到:

因此,用

来表示

,我们就会发现 softmax 回归器预测其中一个类别的机率为

,另一个类别机率的为

,这与 logistic回归是一致的。

Softmax 回归 vs. k 个二元分类器

如果你在开发一个音乐分类的套用,需要对k种类型的音乐进行识别,那幺是选择使用 softmax 分类器呢,还是使用 logistic 回归算法建立 k 个独立的二元分类器呢?

这一选择取决于你的类别之间是否互斥,例如,如果你有四个类别的音乐,分别为:古典音乐、乡村音乐、摇滚乐和爵士乐,那幺你可以假设每个训练样本只会被打上一个标籤(即:一首歌只能属于这四种音乐类型的其中一种),此时你应该使用类别数k= 4的softmax回归。(如果在你的数据集中,有的歌曲不属于以上四类的其中任何一类,那幺你可以添加一个“其他类”,并将类别数k设为5。)

如果你的四个类别如下:人声音乐、舞曲、影视原声、流行歌曲,那幺这些类别之间并不是互斥的。例如:一首歌曲可以来源于影视原声,同时也包含人声 。这种情况下,使用4个二分类的 logistic 回归分类器更为合适。这样,对于每个新的音乐作品 ,我们的算法可以分别判断它是否属于各个类别。

当前我们来看一个计算视觉领域的例子,你的任务是将图像分到三个不同类别中。(i) 假设这三个类别分别是:室内场景、户外城区场景、户外荒野场景。你会使用sofmax回归还是 3个logistic 回归分类器呢? (ii) 当前假设这三个类别分别是室内场景、黑白图片、包含人物的图片,你又会选择 softmax 回归还是多个 logistic 回归分类器呢?

在第一个例子中,三个类别是互斥的,因此更适于选择softmax回归分类器 。而在第二个例子中,建立三个独立的 logistic回归分类器更加合适。

中英文对照

Softmax回归 Softmax Regression

有监督学习 supervised learning

无监督学习 unsupervised learning

深度学习 deep learning

logistic回归 logistic regression

截距项 intercept term

二元分类 binary classification

类型标记 class labels

估值函式/估计值 hypothesis

代价函式 cost function

多元分类 multi-class classification

权重衰减 weight decay